李爱军著Encoding and Decoding of Emotional Speech: A Cross-Cultural and Multimodal Study between Chinese and Japanese(《情感语音的编码与解码——中日跨文化的多模态研究》)于2015年由德国施普林格出版社(Springer-Verlag)出版。本书也是施普林格出版社的系列图书“韵律、音系和语音”(Prosody, Phonology and Phonetics)中的一种。

图书封面照片

这本研究性专著首次从中日跨文化角度出发,利用心理语言学和语音学研究方法探讨多模态情感语音的编码、解码机制以及编解码之间的关系。

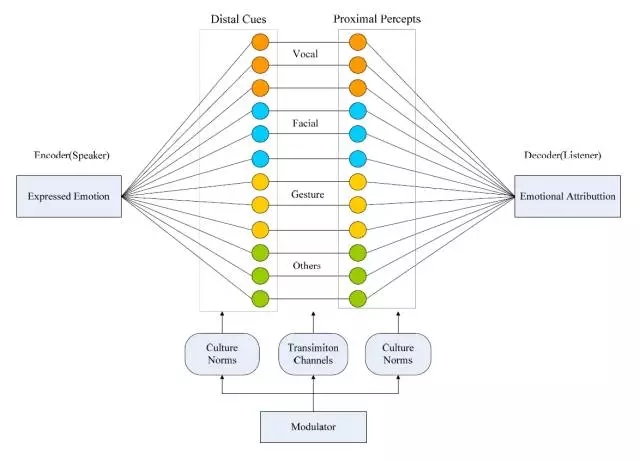

人在交际过程中无时无刻不对各种模态的信息进行编码、解码和综合理解,而情感传递和感知就是信息交互的重要组成部分。该研究基于改进的Brunswikian透镜模型(图1),探索跨文化多模态情感语音的编码、解码以及编解码之间的关系,特别是交际双方的不同语言文化背景及情感传递模态对情感编码和解码的影响。研究内容不但是心理学和认知科学,同时也是人机交互系统中意图理解的关注热点。

全书围绕对3个问题进行探讨:(1)情感解码过程。包括情感感知模式和近端特征与说话人及听话人的语言文化背景,及其传输模态的关系,感知到的情感范畴与感知到的情感近端特征之间的关系,以及在音视频模态的情感冲突时,是否出现情感的McGurk效应。(2)情感编码过程。包括情感的发音和声学特征,以及这些特征是否也与交际者的语言文化背景相关。(3)情感编码和解码的关系。包括情感韵律特征如边界调对情感表达的贡献等。

图1:情感交互:改进的Brunswikian透镜模型

研究通过对6种基本情感和中性情感的声音和面部表情动作感知特征分析,初步厘清了情感解码的过程与交际双方的语言文化背景以及不同传输模态的关系。6种基本情感包括:生气、高兴、害怕、难过、惊讶、厌恶和中性等,多模态通道主要包括:情感语音单输入(Aonly)、情感面部表情单输入(Vonly)、情感表情与声音一致(AVC),以及表情与声音冲突(CAV)等四种通道。

情感解码研究中,同时对比分析母语和二语学习者的情感感知(即让汉语母语的日语学习者和日语母语的汉语学习者,对汉语情感材料和日语情感材料分别进行辨认),用以考察跨文化多模态的情感感知与语言文化的关系。研究得到中日情感感知模式、声音和面部情感特征;厘清了情感解码过程与交际双方的语言文化背景以及不同传输模态的关系;建立了音视频感知特征与感知情感的关系。

首先,中日感知模式和感知特征有异有同,说明情感感知既有跨文化的心理基础,但也受到语言文化背景的影响。在仅声音(Aonly)、仅面部表情(Vonly)以及声音和面部表情一致(AVC)三种模态下,不同语言文化背景的听音人都能对发音人的7种情感进行感知,结果都好于机会水平。但是有面部表情的模态,即Vonly和AVC模态下的跨语言的情感感知结果好于只有声音一个通道(Vonly)的结果。这说明面部表情在跨文化的情感感知中贡献大于声音。

此外,中日听辨认都可以感知到一些相同的远端和近端语音与面部表情特征,而且面部特征多于声音特征。进一步说明情感的解码有跨文化的心理基础,而且面部表情模态在跨文化的情感解码中贡献更大,而声音模态受到交际双方的语言文化背景影响大于面部表情;但是也发现说话人采用不同的策略进行情感表达,一些人善于使用面部表情,而另外一些人更善于使用声音来表达情感。比如,我们的语料显示日本人比较善于用面部表情表达悲伤和生气。情感语音的内容对情感的编码影响较小。

当声音和面部表情不一致的时候(CAV),人们对情感感知是否会出现情感McGurk效应呢?确实可以。CAV模态的感知模式、以及情感McGurk效应等也都与交际双方的语言文化背景相关。研究发现,音频和面部表情模态对情感解码贡献大小与情感的唤醒度相关。具有较高唤醒度的情感,如高兴、生气等,面部表情对情感的感知贡献更大,具有较低唤醒度的情感,如害怕、难过等声音通道对情感的感知贡献更大。

图2:情感McGurk效应是指音视频通道情感信息冲突时,感知到另外一种情感的情况。如中国人“难过”的面部表情配上“生气”的声音,中国人感知为“惊讶”,而日本人感知为“生气”。前者可称之为出现了情感McGurk效应。(发音人为安玉辉)

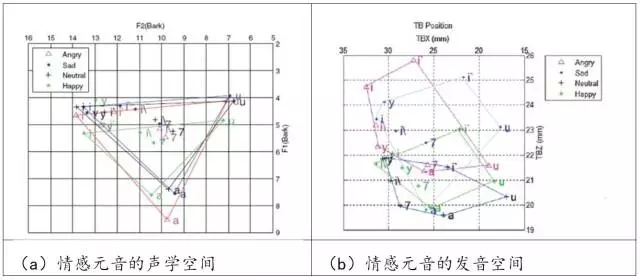

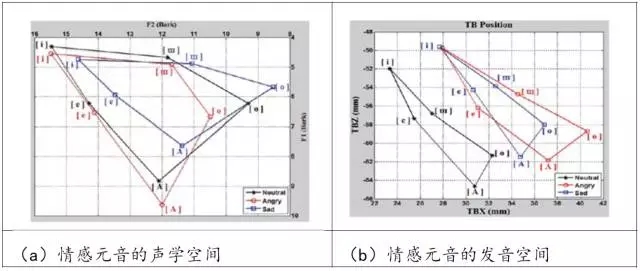

研究还从情感元音的声学和生理发音特征、情感语调等方面探索了情感语音的编码机制,发现中日之间情感编码存在相同点也存在跨文化的差异。中日情感元音的声学空间和发音空间在4种情感之间都表现出明显的变化(图3和4);发音空间中,表达难过和生气情感时,舌位高于高兴和中性情感,同时中日表达愤怒和难过的元音都出现突唇的动作。汉语情感元音有舌位高举动作,日语情感元音舌位高举的同时还有后缩的动作。对于声学上易混淆的情感,如“高兴”和“生气”,其发音空间却有很大的差异。从超音段特征看,情感语调的调域和调阶在7种情感中都存在显著差异,中国人的音域显著大于日本人,研究还首次发现中国发音人用后续叠加边界调表达情感(图5)。

因此,中日语言文化背景之间情感编码和解码有相同点,也有跨文化的差异。通过分析情感语调的声学特征与情感表达的关系,说明情感语音的编码和解码之间是复杂的多对多关系。

图3:汉语普通话发音人的情感元音声学空间和发音空间

图4:日本发音人的情感元音声学空间和发音空间

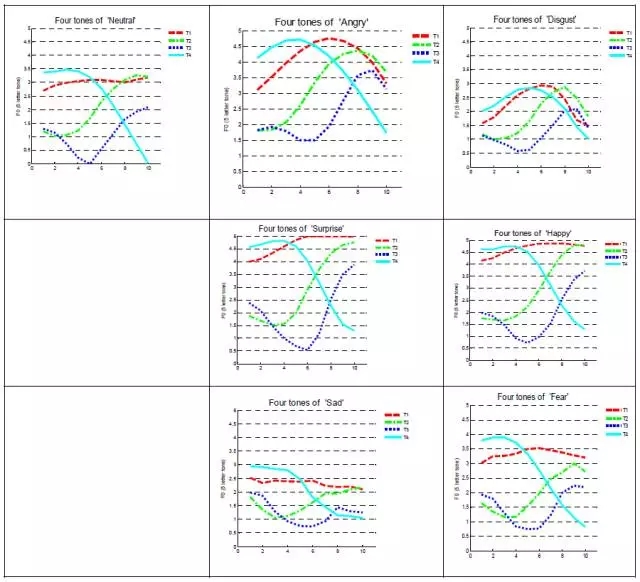

图5:汉语普通话单音节(四种声调)在7种情感句中的语调模式(时长规整),F0按照发音人的5度值规整。与中性情感相比,在表达生气和厌恶情感的四声后出现了一个下降的尾巴,高兴和惊讶的四声后出现了一个上扬的上升的尾巴,这正是赵元任先生提出的后续叠加边界调(SUABT:successive addition boundary tone)。

该研究得到了中国社会科学院创新工程项目、国家自然科学基金项目、日本振兴学会基金项目以及国家973项目的支持。

作者介绍

李爱军,中国社会科学院语言研究所语音研究室主任、研究员,中国社会科学院研究生院教授、博士生导师,中国社会科学院创新工程项目“语音与言语科学重点实验室”负责人,《中国语音学报》主编、中国语音学会副主任,SIG-CSLP委员会委员,OCOCOSDA中国代表。专业方向和研究领域为语音学和语言习得。2010年被推选为新世纪百千万人才工程国家级人选。